Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Produisez des contenus multimédias à l'aide de l'IA générative

Les intelligences artificielles génératives transforment radicalement notre rapport à la création. Nous sommes entrés dans une ère où les machines peuvent rédiger des textes, générer des images, créer des vidéos ou encore reproduire des voix avec une précision troublante.

Ce progrès, aussi fascinant soit-il, interroge :

Ces outils augmentent-ils notre créativité ou la remplacent-ils ?

Que peuvent-ils réellement faire, et où se situent leurs limites ?

Prenons le temps de découvrir, ensemble, ces outils de plus en plus présents dans notre quotidien.

Générez du texte avec un LLM

L'écriture est désormais assistée par des modèles d'IA comme GPT-4 ou Gemini. Ces modèles peuvent rédiger des articles, synthétiser des documents ou reformuler des idées avec un style précis.

Samir, notre coach en ligne virtuel, utilise ces outils pour rédiger ses newsletters hebdomadaires. Il entre un sujet dans ChatGPT, demande un ton professionnel mais accessible, et obtient un brouillon structuré qu’il peut ensuite enrichir ou ajuster selon ses besoins. L’interface de ChatGPT lui permet d’itérer sur ses textes très simplement, avec des options de reformulation, de résumé ou de développement à portée de clic.

Générez des images avec l’IA générative

L’image est sans doute le domaine où l’IA générative a connu les évolutions les plus spectaculaires. DALL·E, intégré dans ChatGPT, et ImageFX dans Gemini permettent aujourd’hui de créer une image cohérente, réaliste ou artistique à partir d’un simple texte. Sora, quant à lui, permet de styliser ou d’animer ces images pour des expériences plus immersives.

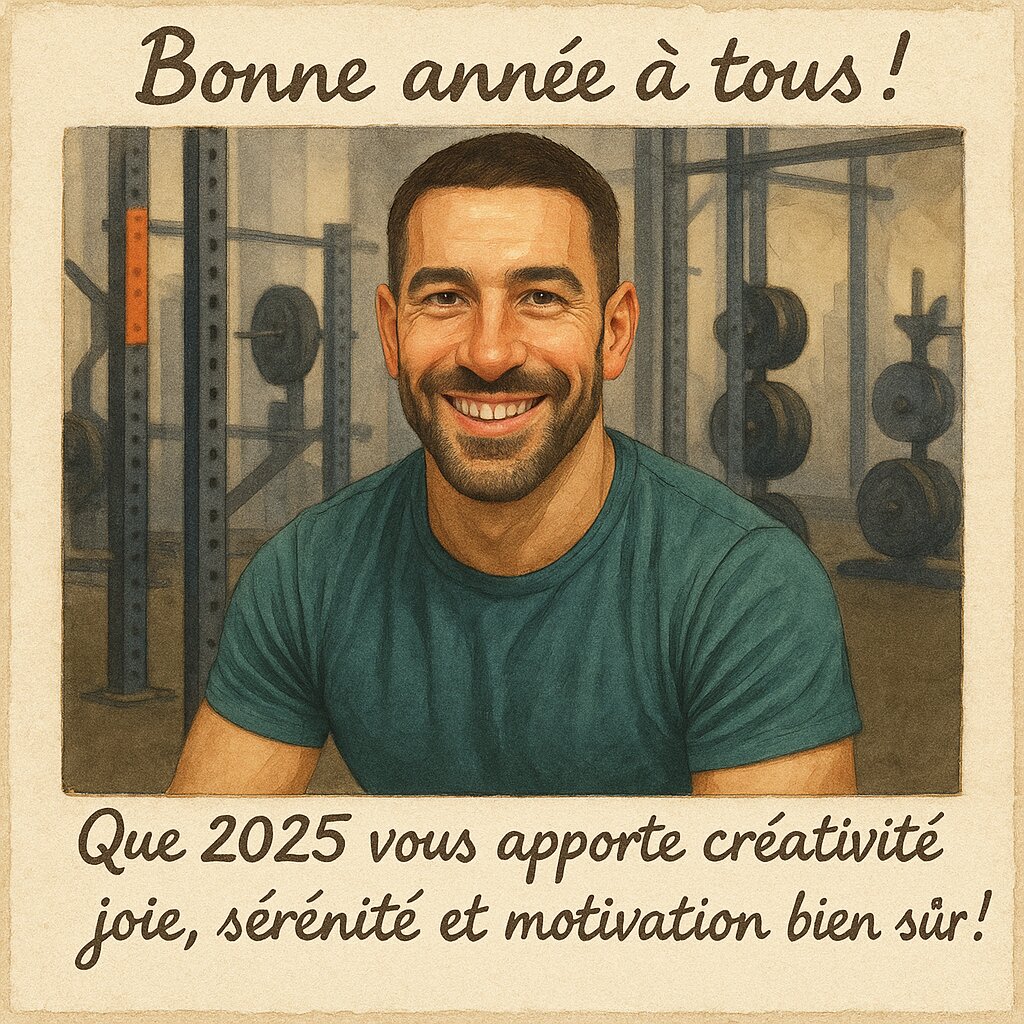

Exemple : Samir crée son avatar visuel

Samir souhaite personnaliser son site professionnel. Il décide de créer un visuel stylisé de lui-même pour illustrer ses formations.

Étape 1 : Génération d’image avec ChatGPT

Il ouvre ChatGPT4o ou 5 et utilise DALL·E 3 et entre le prompt suivant :

Portrait digital souriant, dans un bureau moderne avec des plantes vertes, style digital painting.

L’outil lui propose plusieurs rendus, qu’il peut ajuster en fonction de son style de communication. Il sélectionne une image qu’il trouve dynamique et rassurante.

Étape 2 : Création d’une carte de vœux personnalisée

Quelques jours plus tard, Samir veut adresser un message à ses clients à l’occasion de la nouvelle année. Il utilise de nouveau ChatGPT avec DALL·E 3 et entre ce prompt :

Carte de vœux chaleureuse, style carnet de voyage, avec l'inscription manuscrite “Bonne année à tous ! Que 2025 vous apporte créativité, joie, sérénité, et motivation bien sûr !"

En quelques secondes, il obtient une image illustrée, personnalisée et parfaitement adaptée à son public.

Nous venons de voir comment Samir utilise l’IA générative pour créer des visuels puissants et engageants. C’est un tournant majeur dans les usages créatifs ! En exploitant à la fois les capacités des modèles de langage et la génération d’images associée, Samir enrichit considérablement ses communications.

Comment cela fonctionne ?

Derrière ces images impressionnantes se cachent des réseaux neuronaux entraînés sur des millions de visuels. Grâce à cet apprentissage massif, les IA peuvent recombiner formes, textures et couleurs pour créer des rendus convaincants à partir d’une simple description.

Et lorsque les résultats bruts méritent d’être sublimés, des outils comme Magnific.AI entrent en scène.

Imaginez un filtre magique capable de transformer une vidéo un peu floue, banale ou imparfaite, en une œuvre aux détails précis, à la lumière retravaillée et à la résolution spectaculaire.

C’est exactement ce que fait Magnific.AI : il agit comme une loupe numérique dotée de sens artistique.

Cet outil est aujourd’hui largement intégré dans les flux de production assistée par IA. Il assure la dernière étape de la chaîne : celle où l’on passe d’un prototype brut à un rendu abouti, prêt à être diffusé ou publié.

Voyons maintenant comment ces images peuvent prendre vie sous forme de vidéos animées.

Générez des vidéos avec l’IA générative

Après avoir vu comment Samir utilise l’IA pour produire des textes et des images, passons maintenant à une autre dimension fascinante : la vidéo. Aujourd’hui, créer une vidéo animée ne nécessite plus de caméra ni de studio. Grâce à des outils comme Runway, Veo2 ou Sora, il devient possible de produire des séquences visuelles à partir de simples descriptions textuelles, d’images fixes, ou même de vidéos déjà existantes.

Exemple 1 : Samir crée une capsule vidéo pour son site

Après avoir généré son avatar, Samir souhaite créer une animation courte pour l’accueil de son site internet.

Étape 1 : Choix de l’outil

Samir décide d’utiliser Gemini de Google et son modèle de génération vidéo Veo3.

Étape 2 : Animation avec Gemini Il se rend sur Gemini et sélectionne l’option vidéo

Je souhaite créer une capsule video d’accueil pour mon site internet dédié à mon coaching sportif.

Le résultat est fluide mais imparfait il décide d’itérer plusieurs fois afin d’obtenir une vidéo satisfaisante sans avoir eu recours à un tournage onéreux ni même aucun acteur ! L’IA permet donc d’animer et produire sans compétences en motion design ou tournage, avec un rendu professionnel.

Exemple 2 : Samir veut faire parler son avatar

Samir, qui avait déjà généré son avatar avec ChatGPT et lui avait donné vie avec Sora, souhaite désormais passer un message parlé avec ce dernier pour sa capsule vidéo.

Il commence par enregistrer sa voix dans une pièce qui résonne beaucoup. Le son est imparfait. Il passe le fichier dans Adobe Podcast Enhance, qui le nettoie et lui donne un rendu professionnel. Puis, il importe son image dans Runway, qui réalise automatiquement une animation labiale synchronisée (technique qui fait bouger les lèvres d’un personnage vidéo pour qu’elles correspondent parfaitement aux paroles ou au son enregistré).

Résultat : une vidéo fluide, avec un avatar parlant, parfait pour sa page d’accueil. Sans studio, ni tournage, Samir donne vie à son identité numérique.

Maintenant que Samir maîtrise l’image et la vidéo, il souhaite enrichir son projet avec du son.

Voyons comment il s’y prend.

Génération vocale réaliste

Si vous avez déjà écouté l’introduction audio de ce chapitre, vous avez pu entendre une voix synthétique reproduisant une discussion. Cet extrait a été généré avec Eleven Labs, un outil de génération vocale ultra-réaliste.

Pour tester la puissance des voix génératives, vous pouvez aussi vous rendre sur le site Sesame. Choisissez une voix comme Maya ou Miles et engagez la conversation (en anglais). Même sans comprendre, vous serez bluffé par le naturel des intonations.

Qu’est-ce que le voice-over ?

Contrairement au doublage classique, le voice-over consiste à superposer une voix à la piste audio originale, sans en effacer les sons. C’est une méthode très utilisée dans les documentaires ou les reportages multilingues.

L’IA ne se limite pas au texte. Les images, les vidéos et les sons sont également générés par des algorithmes de plus en plus performants et c’est ce que nous allons voir à présent !

Voici une première vidéo d'expert :

Et en voici une seconde :

Les vidéos des experts sont-elles authentiques ?

C’est une excellente question. Oui pour la seconde, ce sont bien les vrais experts que vous voyez dans les vidéos de ce cours. Cependant, selon leur langue d’origine (italien, allemand, danois…), certaines vidéos ont été adaptées avec un traitement de lip-sync pour vous proposer une version en anglais fluide et naturelle. La première vidéo elle et bien n’existe pas ! C’est un avatar virtuel créé à partir d’une personne réelle et nous pouvons ensuite à loisir la possibilité de la faire parler sur différents sujets.

Nous avons maintenant parcouru les trois grands champs d’application de l’IA générative : le texte, l’image et le son. Mais attention : comme toute technologie, ces outils ont leurs limites. Pour en tirer le meilleur, il est essentiel d’en comprendre les biais et les contraintes.

Veillez aux limites techniques et les biais potentiels

Maintenant que vous connaissez les principaux acteurs et ce qu’ils sont capables de produire, prenons un peu de recul : gardons en tête certaines limites et biais dans la création de ces contenus générés par l’IA.

La génération de texte

Limitations | Bonnes pratiques |

Hallucinations informationnelles : L’IA peut générer des faits inexacts avec un aplomb troublant. Mémoire limitée : la taille du contenu (sa longueur) peut influer parfois sur la capacité de l’IA à rester cohérente et stable. Manque de nuance : l’IA peine parfois à saisir des subtilités culturelles et contextuelles. | Si les IA peuvent générer du contenu de manière impressionnante, elles ne garantissent pas sa véracité. Il est donc essentiel de :

|

La génération d’images et de vidéos

Malgré leur puissance, ces technologies rencontrent plusieurs limitations techniques :

Durée réduite : les vidéos générées sont souvent courtes (quelques secondes), ce qui impose un travail de montage pour obtenir une séquence plus longue et cohérente.

Transitions difficiles et cohérence visuelle : le passage d’une scène à une autre manque encore de fluidité, et la gestion des modèles, des plans et de la direction artistique peut manquer de constance.

Consommation énergétique élevée : ces IA nécessitent des infrastructures coûteuses en calcul et en énergie.

La génération d’audio

Manque de spontanéité : bien que les voix générées soient de plus en plus réalistes, elles restent parfois trop mécaniques.

Problèmes de sécurité : la génération de voix clonées pose des questions éthiques, notamment en matière d’usurpation d’identité et de deepfakes.

Dépendance au cloud : la plupart de ces outils fonctionnent via des serveurs distants, soulevant des préoccupations en matière de confidentialité des données.

Droits d’auteur : aujourd’hui les contenus graphiques générés par des IA comme chatGPT sont très surveillés et les LLM comme chatGPT peuvent même catégoriquement refuser de traiter une demande; si cette dernière entraînait un plagiat ou une inspiration bien trop prononcée d’une œuvre originale.

À vous de jouer

Contexte

Atelier Novalis prépare une offre « contenus multimédias assistés par IA » pour des TPE. Il faut rapidement cartographier quels types d’outils mobiliser (LLM pour le texte, générateurs d’images, vidéo, voix) et quelles limites surveiller (hallucinations, cohérence visuelle, confidentialité).

Consigne

Demandez à ChatGPT de produire un prompt de génération d’image pour créer une infographie claire et professionnelle. Cette infographie doit aider une TPE à comparer 4 cas d’usage de l’IA générative (Texte, Image, Vidéo, Audio). Pour chaque cas d’usage, l’image doit représenter :

un bénéfice concret,

une limite ou un risque,

une bonne pratique de validation humaine.

En résumé

Les IA génératives permettent de produire du texte, des images, des vidéos et des voix, transformant les usages créatifs et professionnels au quotidien.

Des outils comme GPT-4, Gemini et DALL·E 3 assistent la rédaction et la création visuelle, tandis que Sora, Runway ou Veo2 génèrent et animent des vidéos.

Des technologies comme Magnific.AI améliorent la qualité des rendus visuels, et Eleven Labs produit des voix synthétiques réalistes capables d’émotions nuancées.

Malgré leurs performances, ces outils présentent des limites : hallucinations textuelles, manque de cohérence visuelle, vidéos courtes, consommation énergétique élevée et voix parfois trop mécaniques.

Les enjeux éthiques incluent la confidentialité des données, les risques de deepfakes, les questions de droits d’auteur et la nécessité d’une supervision humaine pour valider les contenus.

L’IA générative ne cesse d’évoluer. Si elle repousse les frontières de la création, elle impose aussi des responsabilités en matière d’éthique, de sécurité et de contrôle humain. Et c'est ce que nous allons voir dans la seconde partie de ce cours. Mais avant de poursuivre dans cette direction, je vous invite à tester vos connaissances dans le quiz clôturant cette partie.

Ever considered an OpenClassrooms diploma?

- Up to 100% of your training program funded

- Flexible start date

- Career-focused projects

- Individual mentoring

Find the training program and funding option that suits you best