Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Exploitez l’IA pour enrichir la création culturelle

Considérez l’IA comme nouvel outil de création artistique

C’est l’histoire de Léa, médiatrice culturelle dans un centre d’art contemporain. Depuis des années, son métier consiste à imaginer des parcours, des expositions, à rendre l’art accessible à tous.

Un matin, Marc, le directeur, lui propose de tester un nouvel outil : une IA générative.

D’abord méfiante, Léa décide de s’en servir pour créer des visuels immersifs pour la prochaine exposition, des ambiances sonores générées à partir de descriptions, et même une fresque numérique qui réagit aux mouvements des visiteurs.

L’écran se remplit de propositions. Certaines sont bancales, d’autres incroyablement inspirantes. Mais l’enjeu n’est pas seulement technique. Léa comprend que l’IA n’est pas là pour remplacer les artistes, mais pour imaginer autrement. Ce qui rend ces outils utiles, c’est ce qu’en fait son utilisateur. C’est lui qui décide du cadre, de la thématique, de l’intention. Il lance la démarche, sélectionne, ajuste.

Maîtrisez l’IA pour préserver la culture et la diversité

Léa le constate chaque jour dans son centre d’art : l’IA est devenue un véritable outil pour le secteur culturel. Elle permet de préserver, valoriser, comprendre, promouvoir et rendre accessible le patrimoine, qu’il soit matériel ou immatériel. Les musées, galeries, bibliothèques ou archives peuvent s’en servir pour mieux mettre en valeur leurs collections et les rendre accessibles à un plus large public.

Mais plus Léa explore ces outils, plus elle en mesure les limites. L’IA peut aussi favoriser la concentration des contenus, des données et des marchés.

Résultat : certains récits, certaines expressions culturelles finissent par disparaître au profit de contenus standardisés. Les biais présents dans les systèmes viennent amplifier ces dérives, avec un impact direct sur la diversité culturelle, sociale et artistique.

Alors, Léa comprend qu’il est essentiel de prendre le temps d’évaluer l’impact culturel de l’IA. Son objectif : tirer le meilleur de ces technologies pour rapprocher les publics, enrichir la médiation et favoriser la compréhension, sans perdre ce qui fait la richesse des cultures.

Pour Léa, une chose est claire : il faut former les artistes, les médiateurs et tous ceux qui travaillent dans la culture à l’IA et aux outils numériques. Sans ça, difficile de comprendre comment ces technologies fonctionnent, de les adapter aux besoins du terrain… ou même d’en poser les limites. Par exemple, si un musée utilise une IA pour créer des visites immersives, il faut que ses équipes sachent comment s’assurer que les contenus respectent l’histoire et les cultures représentées. C’est la seule façon de préserver ce qui compte vraiment : le patrimoine, la diversité et la liberté de créer.

Identifiez l’impact social et les risques potentiels

L’arrivée de l’IA dans la création n’a rien de neutre. Elle bouleverse les pratiques, redéfinit les rôles et change l’accès à la culture.

Créer devient plus simple, plus accessible, notamment pour des publics éloignés. Mais Léa sait aussi que cette facilité a ses limites : sans accompagnement, l’IA reproduit des stéréotypes, simplifie, lisse, et parfois vide de sens.

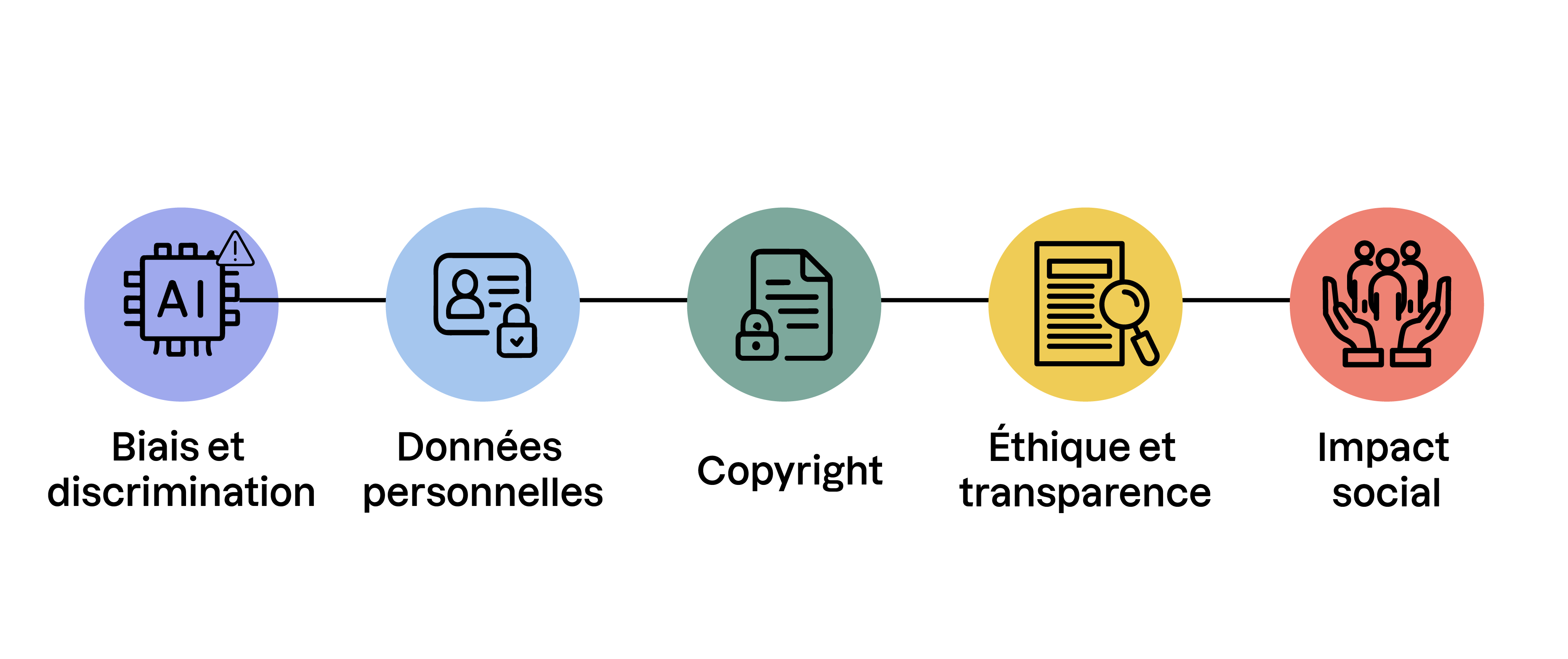

L’usage de l’IA dans la culture soulève en effet des enjeux majeurs, à la fois sociaux et juridiques que nous allons voir maintenant :

Biais et discrimination. Les IA sont entraînées sur des bases de données souvent biaisées, majoritairement occidentales. Résultat : des représentations stéréotypées, des cultures minoritaires invisibilisées. Pour aller plus loin sur le sujet, consultez cet article de Wired (23 avril 2025). Margaret Mitchell, experte en éthique de l’IA, explique que les IA propagent des stéréotypes nocifs, malgré les tentatives de correction. Les outils de réduction des biais restent centrés sur l’anglais, négligeant les spécificités culturelles des autres langues, ce qui favorise la diffusion globale de préjugés.

Atteinte aux données personnelles. Le recours à des IA ne permet pas de s’exonérer de la protection des données à caractère personnel comme le nom et le prénom. Or, beaucoup de ses données ont été aspirées sans autorisation et l’IA peut porter atteinte au droit à l’image, à la vie privée ou créer des manquements au RGPD. On a pu le constater dans la plainte d'Eric Bothorel. Ce député français a intenté une action contre ChatGPT, accusant l'outil d'IA de diffuser des informations erronées à son sujet. Il dénonce une atteinte à sa réputation et soulève des questions sur la responsabilité des éditeurs d'IA concernant la véracité des contenus générés.

Atteintes aux droits d’auteur. Les IA peuvent générer des œuvres très proches de créations existantes. Le risque de contrefaçon est donc réel, même sans acte volontaire et l’utilisateur peut engager sa responsabilité civile et pénale. Exploiter des œuvres issues de ces IA pose un risque d’atteinte aux droits. Léa se demande si elle ne participe pas, malgré elle, à l’exploitation d’œuvres protégées sans autorisation. Aux États-Unis, trois artistes américaines (Sarah Andersen, Kelly McKernan et Karla Ortiz) ont porté plainte en janvier 2023, contre Stability AI, Midjourney et DeviantAre, pour avoir utilisé leurs œuvres sans consentement afin d’entraîner des IA génératives. Elles dénoncent une atteinte massive aux droits d’auteur concernant plus de 20 000 artistes.

Transparence et devoir d’information. L’AI Act impose de signaler clairement quand un contenu est généré par IA. C’est aussi un impératif éthique pour lutter contre la confusion entre œuvres humaines et productions synthétiques. Le Journal Le Monde a, par exemple, rédigé un article sur la manière dont ils utilisent l’IA.

Impact social. L’IA facilite l’accès à la création, mais transforme profondément les pratiques professionnelles. L’artiste peut devenir concepteur de prompts. Cette démocratisation s’accompagne d’un risque : la standardisation des œuvres, liée à des modèles entraînés sur des bases de données homogènes, qui peuvent appauvrir la diversité culturelle et invisibiliser certaines expressions artistiques. Aoki Studio, spécialisé dans l'animation et des effets spéciaux au Japon, a listé 50 arguments contre l’utilisation de l’IA dans les domaines créatifs.

Léa comprend finalement que pour garder du sens, elle doit apprendre à travailler avec ces outils sans perdre de vue sa mission de transmission, de sens critique et de préservation de la diversité.

Comprenez les enjeux de l’IA dans l’art et la culture

Au-delà de la technique : une responsabilité juridique et éthique

Léa anime désormais ses conférences avec deux questions essentielles :

Peut-on considérer une œuvre générée par une IA comme une véritable création artistique ?

En cherchant à produire plus vite grâce à l’IA, ne risque-t-on pas de dévaloriser le travail des artistes… et de contribuer, paradoxalement, à affaiblir la création elle-même ?

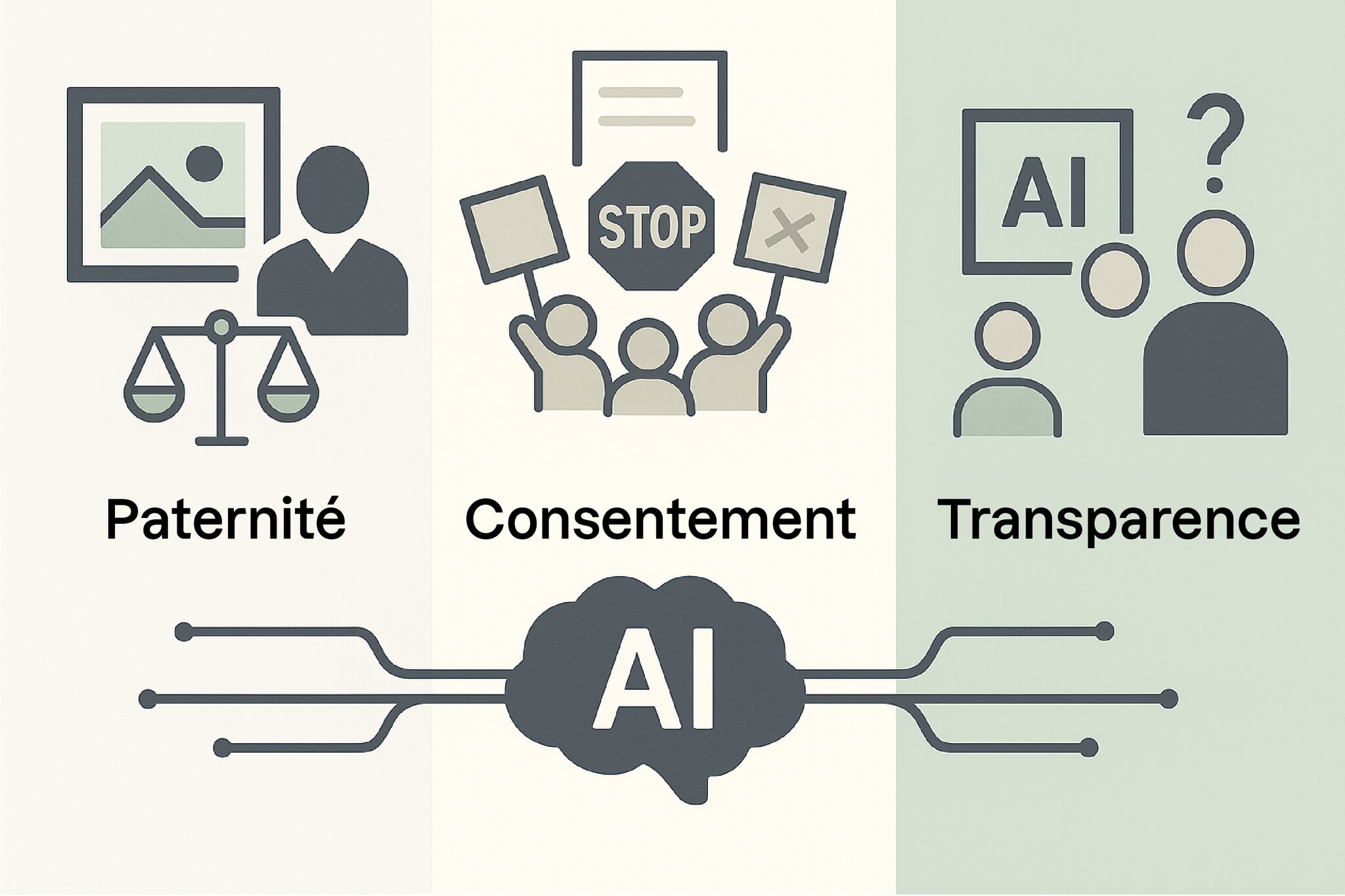

Derrière cette interrogation, se cachent des enjeux concrets :

La question de la paternité. D’un point de vue juridique, seul un être humain peut être auteur. L’absence d’intention de la machine interroge directement la qualification d’“œuvre” et les droits qui en découlent.

Le problème du consentement. Une large part des IA créatives repose sur des bases de données alimentées sans l’accord des artistes. Produire une œuvre générée à partir de ces modèles, c’est potentiellement exploiter des contenus protégés, sans rémunération ni reconnaissance des auteurs.

La nécessité de la transparence. Informer le public que l’œuvre a été générée par IA devient non seulement une exigence éthique, mais aussi une obligation juridique (imposée par l’AI Act, comme nous l’avons vu précédemment).

Une exception dite de “fouille de texte et de données”, prévue par la directive européenne du 17 avril 2019, et transposée en droit français aux articles L122-5, 10° et L122-5-3 du Code de la propriété intellectuelle, autorise la conception et l'entraînement de systèmes d’IA à partir d’œuvres dans certaines conditions. Une distinction essentielle est opérée entre les usages non-commerciaux et commerciaux. Si les auteurs ne peuvent s’opposer à l’usage de leurs œuvres dans le premier cas, ils peuvent s’y opposer “de manière appropriée, notamment par des procédés lisibles par machine pour les contenus mis à la disposition du public en ligne” dans le second cas.

Dans tous les cas, la mise en œuvre de l’exception de fouille de texte et de données suppose un accès licite aux œuvres.

Face à ces enjeux, une chose est claire : le choix appartient à son utilisateur. Utiliser l’IA, c’est aussi faire des choix éthiques et juridiques. Respecter le travail des artistes, vérifier la provenance des données, être transparent sur l’usage de l’IA…

Léa a compris que chaque créateur, chaque professionnel a un rôle à jouer pour que l’innovation ne se fasse pas au détriment de la création. L’IA n’est pas responsable : c’est l’usage qu’on en fait qui l’est. Elle choisit désormais ses outils avec discernement, documente ses processus et forme le public à ces enjeux pour construire une pratique plus respectueuse des droits et des valeurs culturelles.

Quand l’IA bouscule la notion d’authenticité

Et puis, une autre question surgit pour Léa.

Face à une œuvre générée par IA, l’authenticité est-elle toujours là ?

Si l’émotion ressentie est réelle, est-ce important qu’elle soit créée par une machine ? Ou bien l’art ne peut-il exister que s’il porte une intention humaine ?

Léa se retrouve face à un choix : comment présenter ces œuvres ? Comme de vraies créations ou comme de simples expérimentations techniques ?

Derrière cette question se cache un choix fondamental : quelle place voulons-nous donner à l’IA dans notre rapport à l’art et à la culture ?

Ce débat n’est pas seulement éditorial ou esthétique. Il est profondément éthique. Parce qu’il touche à ce qui fait la valeur d’une œuvre : son origine, son intention, et le lien invisible qu’elle tisse avec celles et ceux qui la regardent.

Étudiez le cas de la muséologie et de la préservation numérique

Léa pousse la réflexion plus loin. Dans le musée, une réflexion collective s’engage : et si l’IA servait aussi à préserver le patrimoine ?

Une toile endommagée ? L’IA aide à reconstituer les parties manquantes, à partir de descriptions anciennes et d’archives.

Des objets non documentés ? Elle identifie les styles, les périodes, enrichit les bases de données.

Une salle détruite il y a 50 ans ? Le musée propose une visite immersive en réalité augmentée, reconstituée grâce à des modèles IA.

On pourrait toutefois s’interroger, comme Léa, sur la nature juridique de cette reconstitution, et s’il est possible de la présenter comme une œuvre fidèle ou comme une interprétation algorithmique.

Découvrez les bonnes pratiques

En découvrant l’IA, Léa comprend vite que tout dépend de la façon dont on l’utilise. Entre levier créatif et risque de dérive, elle identifie quelques bonnes pratiques… et de sérieuses erreurs à éviter.

✅ Bonnes pratiques

Gardez la main sur le processus. Ne laissez pas l’IA décider à votre place. Vous êtes l’auteur de la démarche : vous choisissez l’intention, le style, le cadre.

Soyez transparent. Informez clairement votre public lorsque l’œuvre a été générée (ou partiellement générée) par une IA.

Respectez les droits des artistes. Vérifiez si l’outil que vous utilisez a été entraîné sur des œuvres avec ou sans le consentement des auteurs. Évitez de participer, même sans le vouloir, à la contrefaçon.

Développez votre sens critique. Ne vous contentez pas du premier résultat proposé par l’IA. Filtrez, sélectionnez, ajustez pour éviter les biais, les stéréotypes ou les simplifications excessives.

Formez-vous. Comprendre comment fonctionne l’IA, ses limites, ses risques et ses impacts sociaux vous permet de l’utiliser de manière éthique, responsable… et créative.

❌ Erreurs à éviter

Laisser l’IA produire sans contrôle. Générer du contenu sans le vérifier, sans le retravailler ni le questionner peut conduire à des œuvres stéréotypées, biaisées ou juridiquement risquées.

Dissimuler l’origine des contenus. Faire passer une œuvre générée par IA pour une création 100 % humaine est non seulement trompeur, mais aussi contraire à la réglementation (AI Act).

Négliger la question des droits. Utiliser un outil IA sans se soucier de la provenance des données, c’est risquer de porter atteinte aux droits d’auteur ou aux données personnelles.

Chercher uniquement la rapidité. Se servir de l’IA pour produire plus vite, sans réflexion, peut appauvrir la diversité culturelle, encourager la standardisation… et nuire à la qualité de la création.

Penser que l’IA remplace l’artiste. Laisser croire que l’IA “crée” seule revient à effacer la part humaine, l’intention, le regard… et à vider l’œuvre de son sens.

Léa est désormais convaincue que travailler avec l’IA dans la culture, c’est ouvrir de nouvelles voies, mais sans jamais perdre de vue le sens, la responsabilité et l’humain.

À vous de jouer

Contexte

Le Centre d’art Rivage missionne Atelier Novalis pour un atelier participatif où le public co-crée une fresque générative.

Vous formalisez une mini-charte contenant 10 règles :

transparence de l’usage IA,

non-substitution de l’artiste,

diversité des références,

vigilance biais,

respect droits/opt-out,

documentation du processus,

mention explicite IA,

rôle de médiation,

retouche humaine,

retours éthiques

Consigne

Utilisez ChatGPT pour générer cette mini-charte encadrant un atelier de co-création avec IA dans un centre d’art (transparence au public, respect des droits, inclusion, anti-biais, rôle de la relecture humaine).

En résumé

L’IA est présentée comme un outil de co-création artistique qui enrichit les pratiques sans remplacer les artistes, mais dont l’usage doit rester guidé par l’intention et le discernement humain.

Dans le secteur culturel, elle permet la valorisation et la préservation du patrimoine, mais comporte le risque d’homogénéiser les récits et d’appauvrir la diversité culturelle et sociale.

Son usage soulève des enjeux majeurs : biais et discriminations, atteintes aux données personnelles, risques de contrefaçon, nécessité de transparence et transformation des pratiques professionnelles.

L’authenticité et la valeur des œuvres générées par IA sont questionnées, car seule l’intervention humaine confère une véritable intention et une reconnaissance juridique au statut d’auteur.

Des bonnes pratiques recommandent de garder la main sur le processus créatif, de respecter les droits, d’informer le public et de développer un usage critique et responsable de l’IA pour préserver la diversité et l’éthique dans la culture.

Dans la dernière partie du cours, nous découvrirons comment l'IA générative peut être utilisée dans le cadre de l'automatisation du travail mais aussi dans le domaine de la pédagogie et de la santé. Avant de poursuivre, nous vous invitons à tester vos connaissances dans le quiz clôturant cette partie.

Ever considered an OpenClassrooms diploma?

- Up to 100% of your training program funded

- Flexible start date

- Career-focused projects

- Individual mentoring

Find the training program and funding option that suits you best