Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Table of contents

- Part 1

Découvrez les IA génératives

- Part 2

Utilisez l’IA générative dans votre quotidien de citoyen européen

- Part 3

Découvrez les transformations de l’IA générative au service de la société

Identifiez l’usage des assistants virtuels dans la vie quotidienne

Découvrez les assistants virtuels

Aujourd’hui, les assistants virtuels sont partout : dans nos téléphones, nos voitures, nos maisons, et même nos montres. Comprendre leur fonctionnement, leurs limites et leurs usages est indispensable pour les utiliser efficacement et en toute sécurité dans votre quotidien.

Mais qu’est-ce qu’un assistant virtuel ?

Un assistant (ou agent) virtuel est un logiciel capable d'interagir avec un utilisateur en langage naturel (autrement dit en langage « humain », avec des phrases, par opposition au langage informatique) afin de l’aider à réaliser certaines tâches.

Il analyse les requêtes et y répond grâce à des technologies d’intelligence artificielle telles que le traitement automatique du langage naturel (NLP), la reconnaissance vocale et l'apprentissage automatique (machine learning en anglais).

L’agent est-il pour autant « intelligent » ?

Comme le rappelle la CNIL (Commission nationale de l'informatique et des libertés),

Un assistant virtuel n’est pas à proprement parler "intelligent". Les éléments de connaissance proviennent de sources tierces : données en libre accès (encyclopédies en ligne), bases de données contenant des informations renseignées par l’utilisateur (son agenda, son carnet d’adresse, etc.), etc.

À quoi ça sert un assistant virtuel ?

On distingue deux grands types d’assistants virtuels, répondant à des usages différents : les assistants généralistes et les spécialisés.

Les assistants généralistes

Comme Siri, Alexa, Google Assistant ou ChatGPT, ils sont polyvalents et capables de répondre à une grande variété de requêtes générales sous la forme d’échanges textuels ou vocaux.

Ils sont destinés à un large public et utilisent des modèles de langage entraînés sur de vastes corpus de données...

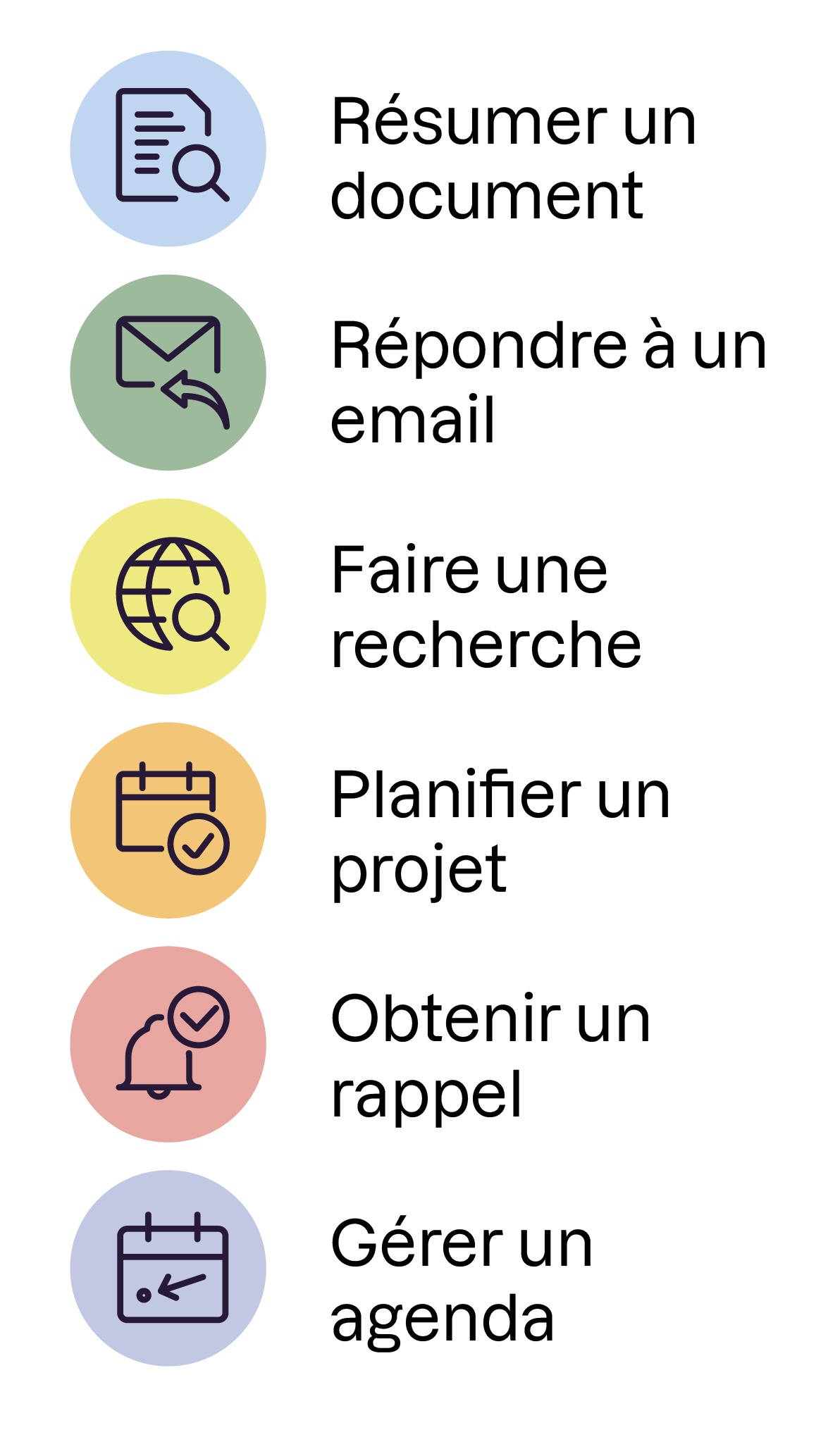

Vous pouvez par exemple grâce à ces agents :

faire un résumé de la traduction de documents ;

répondre à des mails ;

rechercher des informations ;

être aidé à la planification de projets ;

obtenir des rappels d'événements ;

gérer votre agenda et prendre des rendez-vous.

Les assistants spécialisés ou experts

Conçus pour des usages spécifiques, souvent dans un cadre professionnel, ces assistants fonctionnent parfois avec des technologies de RAG (Retrieval-Augmented Generation). Ceci leur permet d'accéder à des bases de données contrôlées et spécialisées afin de générer des réponses plus précises et contextualisées.

Voici quelques exemples d’assistants spécialisés :

L’assistant professionnel comme Microsoft Copilot (à titre d’exemple) est conçu pour assister les employés dans des tâches spécifiques comme la programmation, la rédaction de documents ou l’analyse de données au sein des suites bureautiques et de développement.

Un assistant pédagogique fondé sur un RAG peut interroger des bases de données académiques, des manuels scolaires ou des ressources éducatives certifiées pour proposer des exercices adaptés aux apprenants, y compris ceux avec des besoins spécifiques. Les assistants pédagogiques sont en effet souvent mis au service d’une pédagogie plus inclusive, en proposant des ressources accessibles (en FALC - Facile à Lire et à Comprendre, par exemple, ou oralisées grâce à des systèmes de synthèse vocale).

Les coachs virtuels : De nombreux dispositifs connectés, comme les montres ou bracelets d’activité, intègrent aujourd’hui des assistants spécialisés en santé et en sport. Ils mesurent en temps réel des données comme la fréquence cardiaque, le sommeil ou l’activité physique. Certains proposent un coach virtuel conversationnel, qui interagit avec l’utilisateur pour adapter un programme, suggérer des temps de repos ou motiver l’entraînement. Ces outils rendent le suivi de la condition physique plus accessible et personnalisé, même sans encadrement direct.

Identifiez les avantages en termes de communication et d'assistance personnelle

Voici un tableau récapitulatif sur les avantages, inconvénients et limites dans l’utilisation des assistants personnels :

Avantages | Inconvénients / Limites |

Accessibilité renforcée : permet aux personnes avec des handicaps visuels, moteurs ou cognitifs de mieux interagir avec les outils numériques. | Dépendance : peut réduire l’autonomie ou la capacité à effectuer certaines tâches sans assistance. |

Personnalisation des services : rappels, recommandations, routines quotidiennes adaptées. | Compréhension parfois limitée du contexte : l’assistant peut manquer de nuance ou mal interpréter certaines requêtes. |

Support 24/7 : disponibilité permanente, y compris en dehors des heures de bureau. | Interaction peu humaine : pas d’empathie réelle, parfois frustrant ou limité dans des situations complexes. |

Gain de productivité : préparation de réunions, prise de notes, synthèse d’articles | Confidentialité menacée : transmission non sécurisée de documents sensibles, surtout via des assistants généralistes. |

Accessibilité accrue à l'information : moteur de recherche personnalisé, synthèses adaptées. | Biais algorithmiques : certaines réponses peuvent favoriser des points de vue non représentatifs. |

Passons à présent au cadre réglementaire lié à ces outils.

Veillez au cadre réglementaire, aux questions de sécurité et aux biais potentiels

L’application du RGPD

L’utilisation non autorisée de données personnelles est l’un des risques principaux lorsqu’on utilise un assistant virtuel. En effet, téléverser des documents contenant des donnés à caractère personnel dans un assistant virtuel est susceptible de constituer un traitement de données au sens du droit des données personnelles.

En France et en Europe, c’est le règlement général de protection des données (RGPD) qui définit les règles juridiques dans ce domaine. Il s’applique :

à tous les traitements de données personnelles, c’est-à-dire lors de la phase de développement d’une IA et pendant son utilisation (ou déploiement) ;

aux utilisateurs du service et aux personnes dont les données sont utilisées.

Bien que le Règlement européen sur l’IA (“AI Act”) et le RGPD ne réglementent pas les mêmes objets, les deux textes ont des obligations communes, telles que la transparence et la documentation.

Par ailleurs, comme vous le savez, l’utilisation d’assistants virtuels nécessite, comme pour tout outil d’IA, une importante quantité de données.

Une information compréhensible et la possibilité d’exercer ses droits

Les assistants virtuels produisent leurs réponses en s’appuyant sur des calculs de probabilités. Ce mode de fonctionnement peut entraîner des erreurs factuelles. C’est pourquoi ils invitent généralement les utilisateurs à vérifier l’exactitude des informations fournies.

Comment assurer une transparence suffisante pour que vous compreniez comment vos données personnelles sont utilisées dans ce type d’outil ?

Deux mécanismes doivent être mis en place :

Une mention d’information : Vous devez connaître les raisons pour lesquelles le fournisseur d’IA utilise vos données (traduction, entraînement de l’outil…) et le comprendre de façon claire, accessible et compréhensible. Pas question de les chercher dans les petites lignes des conditions d’utilisation, de vente ou des mentions légales.

L’exercice de vos droits : Vous devez être en mesure d’exercer, auprès du fournisseur d’IA, vos droits (opposition, suppression, rectification…) sur vos propres données (mais uniquement les vôtres).

Les autorités de protection des données en Europe, telles que la CNIL, sont très soucieuses de la protection de la vie privée des individus, tout comme certaines associations.

Ainsi, elles n’hésitent pas à enquêter et à agir contre les fournisseurs de solutions d’IA. Vous trouverez ci-dessous deux exemples :

En 2024, ChatGPT a inventé une histoire totalement mensongère accusant une personne norvégienne d’avoir assassiné deux de ses enfants et tenté de tuer un troisième. Malheureusement, la réponse incluait des éléments réels de la vie personnelle de cette personne. L’association NOYB a déposé une plainte, le 20 mars 2025, auprès de l’autorité norvégienne de protection des données, arguant que de telles « hallucinations » portent atteinte au principe d’exactitude des données personnelles prévu par le RGPD. Elle réclame, par conséquent, la suppression des informations diffamatoires et une amende pour OpenAI. Vous trouverez ici la Plainte officielle NOYB (European Center for Digital Rights) sur les hallucinations diffamatoires de ChatGPT.

Le député Éric Bothorel a déposé une plainte auprès de la CNIL le 12 avril 2023, après que ChatGPT a généré pour lui des informations complètement erronées — notamment une date de naissance fausse, l'attribution de mandats locaux inexistants (mairie, conseil régional), ainsi que des emplois fictifs chez Havas, Orange ou dans le journalisme.

Biais et discrimination

Les assistants virtuels sont développés par des humains et entraînés à partir de données produites par des humains. Or, ces développements et ces données peuvent refléter des stéréotypes, des préjugés ou des inégalités déjà présents dans la société.

Quand on leur pose une question, ils vont en effet s’appuyer sur ce qu’ils ont appris pour formuler une réponse et reproduire ces biais sans en “avoir conscience”.

Par exemple :

proposer systématiquement des métiers techniques à des hommes plutôt qu’à des femmes ;

illustrer la réussite avec des personnes blanches ;

associer certains prénoms à des comportements négatifs.

Et, comme les assistants virtuels sont conçus pour répondre avec assurance, il peut être difficile pour vous de repérer ces biais, de vous rendre compte qu’il s’agit d’une réponse erronée ou inégalitaire.

Ainsi, un article du journal Bloomberg a mené deux enquêtes poussées sur Stable Diffusion et GPT, révélant que le générateur d’images renforçait les stéréotypes raciaux et sexistes (femmes rarement représentées comme médecins, hommes noirs souvent liés à des crimes), tandis que GPT favorisait systématiquement certains profils raciaux et de genre dans le tri de CV et le classement des candidatures. Cette investigation, lauréate du prix Excellence in Technology Reporting (large newsroom) aux Online Journalism Awards 2024, met en lumière l’amplification des biais existants par les IA génératives et soulève d’importantes questions éthiques sur leur usage en recrutement.

Sécurité

Les assistants virtuels rendent de nombreux services, mais ils ne sont pas sans risques. Leur sécurité repose en effet à la fois sur la technologie, la réglementation, et une utilisation éclairée.

Il existe ainsi plusieurs risques :

Stockage non sécurisé : les données peuvent être conservées sur des serveurs sans protection suffisante.

Fuite de données : Samsung en a été victime en 2023.

Exploitation malveillante : en cas d’attaque, un pirate peut détourner un assistant pour collecter des informations ou usurper une identité.

Absence de transparence : vous ne savez pas toujours ce qui est stocké, partagé ou analysé.

Dans ces conditions, il est important que vous preniez certaines précautions. Par exemple, choisissez des fournisseurs d’assistants virtuels qui ont mis en place des mesures de sécurité robustes (chiffrement, accès restreint, journalisation…), vérifiez si vos données personnelles sont protégées, supprimez régulièrement l’historique des conversations (si l’option existe).

Le législateur européen a prévu que certains types de systèmes d’IA, ceux dits à “haut-risque” (santé, justice, ressources humaines, etc.), fassent l’objet d’une certification CE avant d’être mis sur le marché. Ces obligations sont applicables aux assistants virtuels proposant des services dans ces domaines.

Impact social

Les assistants virtuels promettent beaucoup de choses. Mais à mesure qu’ils se généralisent, ils transforment aussi nos usages, nos relations sociales et notre rapport au travail.

En effet, l’usage croissant des assistants virtuels dans les services client (chatbots, réponses automatiques, FAQ intelligentes) remplace progressivement certaines tâches humaines, notamment celles des téléconseillers et agents de support de premier niveau.

Résultat, les effectifs sont réduits sur les postes les plus répétitifs ou standardisés et il existe moins d’opportunités pour les jeunes ou les profils peu qualifiés, qui occupaient souvent ces fonctions.

Toutefois, les assistants ne couvrent pas tout car le besoin d’interactions humaines complexes, empathiques ou personnalisées reste encore aujourd’hui fort. De nouveaux métiers apparaissent donc progressivement comme superviseurs d’IA, analystes qualité des échanges, gestionnaires d’escalade. L’enjeu est d’être capable d’automatiser sans déshumaniser.

Découvrez les bonnes pratiques

Appliquez une méthode de prompt précise (type méthode A.C.T.I.F )

Procédez par itération en demandant des précisions, des sources, etc.

Ne jamais transmettre d’informations personnelles ou confidentielles ;

Par exemple : ne jamais donner à un assistant généraliste des documents comportant le nom de clients ou d’étudiants.

Si vous êtes obligés de le faire, anonymiser les ou demander l’autorisation à chaque personne concernée.

Relisez et vérifiez toujours les informations fournies par les assistants virtuels.

Signaler les erreurs ou les contenus discriminants pour contribuer à améliorer les outils.

À vous de jouer

Contexte

Nadia vous donne ce brief :

Notre client Velours Sport hésite entre mettre en place un chatbot généraliste ou un assistant spécialisé connecté à ses données produits.

Nous devons l’aider à trier les tâches “bot-compatibles” tout en rappelant les précautions en matière de RGPD, transparence et biais.

Consigne

Vous devez préparer un prompt efficace pour ChatGPT afin de réaliser ce tri automatiquement en utilisant la méthode ACTIF.

En résumé

Les assistants virtuels sont des logiciels capables d’interagir en langage naturel pour aider à réaliser des tâches, mais leur “intelligence” repose sur des bases de données externes et non sur une compréhension réelle.

On distingue les assistants généralistes (Siri, Alexa, ChatGPT) polyvalents et les spécialisés (Microsoft Copilot, coachs virtuels, assistants pédagogiques) adaptés à des usages ciblés.

Ces outils offrent accessibilité, productivité et personnalisation, mais présentent des limites comme les erreurs factuelles, le manque de nuance, la dépendance technologique et les biais algorithmiques.

Leur usage soulève des enjeux de confidentialité (RGPD, AI Act), de sécurité (fuites, piratages) et de discrimination (biais de genre, raciaux ou sociaux amplifiés par les données).

Les assistants transforment le travail et la société, automatisant certaines tâches mais créant aussi de nouveaux métiers de supervision et de contrôle, avec la nécessité de garder une dimension humaine dans les interactions.

Maintenant que vous en savez plus sur les assistants virtuels, poursuivons dans le chapitre suivant avec le sujet des médias et de l'information à l'heure de l'IA.

Ever considered an OpenClassrooms diploma?

- Up to 100% of your training program funded

- Flexible start date

- Career-focused projects

- Individual mentoring

Find the training program and funding option that suits you best